Quanto è potente l’intelligenza artificiale? Abbastanza che Anthropic, una delle principali società di intelligenza artificiale, abbia annunciato all’inizio di questo mese che il suo ultimo modello di intelligenza artificiale, Claude Mythos Preview, sarebbe stato disponibile solo per un numero limitato di aziende a causa di problemi di sicurezza, almeno per ora.

Claude Mythos Preview è stato progettato per un uso generale, afferma Anthropic, ma durante i test, l’azienda lo ha trovato estremamente efficace nell’identificare le vulnerabilità nei sistemi di sicurezza di tutti i tipi di software, creando problemi di sicurezza potenzialmente enormi.

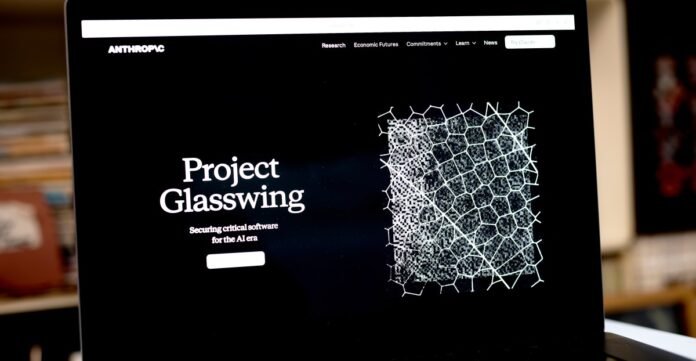

Finora, Anthropic sta condividendo il modello Mythos Preview con una manciata di importanti aziende tecnologiche e banche attraverso un programma chiamato Project Glasswing, inteso a dare loro l’opportunità di sostenere eventuali vulnerabilità di sicurezza esistenti e anticipare potenziali tentativi di hacking che il modello potrebbe identificare.

Per avere un’idea migliore di ciò che rappresenta Claude Mythos Preview e della potenziale minaccia che comporta per la sicurezza online, Oggi, spiegato ha parlato con il co-conduttore Sean Rameswaram Campo Haydenreporter senior di intelligenza artificiale presso The Verge.

Di seguito è riportato un estratto della loro conversazione, modificato per lunghezza e chiarezza. Puoi ascoltare l’episodio completo ovunque trovi i podcast, inclusi Podcast di Apple, PandoraE Spotify.

Mythos è il modello di intelligenza artificiale più recente (di Anthropic) progettato per essere un modello di intelligenza artificiale generico come qualsiasi altro. Ma quello che hanno capito mentre ci lavoravano è che aveva queste abilità speciali che non avevano previsto. Era davvero bravo in sicurezza informatica. Ha rilevato vulnerabilità ad alto rischio praticamente in ogni sistema operativo.

È piuttosto brutto se lo usi come hacker. E per avere un progetto per un elenco di ogni grande lacuna, insicurezza e vulnerabilità su tutti questi sistemi davvero, davvero di alto profilo, avrai un elenco di tutto ciò che potresti fare per abbattere quei sistemi o sfruttare i dati.

Si sono resi conto che era meglio non renderlo pubblico perché potrebbe cadere nelle mani sbagliate. E hanno invece selezionato con cura alcune organizzazioni responsabili delle infrastrutture critiche a cui rilasciarlo in modo da poter invece colmare quelle lacune nei loro sistemi.

Hai sentito parlare di molte delle aziende che attualmente hanno e utilizzano Claude Mythos: Nvidia, JP Morgan Chase, Google, apparentemente qualche dozzina di altre che costruiscono o mantengono infrastrutture software critiche. Come funziona realmente?

Dal momento che lo hanno creato come modello generico, probabilmente funziona come qualsiasi altro modello in quanto lo stai utilizzando e gli viene richiesto di contrassegnare tutte le vulnerabilità nel tuo sistema.

Forse sei Google Chrome e stai cercando parti specifiche e di nicchia del browser che ritieni possano presentare alcune vulnerabilità. In pratica stai spingendo il modello a segnalare tutte queste lacune di alto profilo per te e la tua sicurezza, e poi lo prendi e lo colmi da solo.

Un hacker lo utilizzerebbe effettivamente nello stesso modo. Se cadesse nelle mani sbagliate, direbbero: “Sì, dimmi tutte le vulnerabilità qui”. E poi lo toglieranno dalla piattaforma e lo useranno per qualcosa di nefasto. Fondamentalmente si tratta di chi guida il sistema e quali sono le sue motivazioni.

È facile come dire: “Ehi, Claude, dimmi in che modo questo sistema bancario potrebbe essere vulnerabile”. E poi Claude ci pensa un attimo e tira fuori un sacco di risposte.

E sappiamo che Google e Nvidia nel mondo utilizzano effettivamente questa tecnologia?

SÌ. Parte del motivo per cui Anthropic ha rilasciato questo messaggio è che volevano che queste organizzazioni riferissero esattamente come funzionava Mythos e cosa faceva per colmare le vulnerabilità e le lacune nel loro sistema. È una questione di condivisione delle informazioni.

Stanno permettendo a queste aziende di usarlo per testare quanto riesce a colmare tutte queste lacune di alto profilo, e poi devono riferire ad Anthropic su come ha funzionato.

In che modo Anthropic sceglie con chi condividere questa tecnologia?

In realtà gliel’ho chiesto. Stanno essenzialmente cercando difensori informatici o aziende da cui dipendono molte persone e che a valle sarebbe un grosso problema se venissero violati in qualsiasi modo, forma o forma.

JP Morgan Chase è un ottimo esempio. Anthropic ha offerto questa tecnologia anche al governo.

I concorrenti di Anthropic hanno strumenti simili? Stanno presumibilmente lavorando su strumenti simili?

Apparentemente OpenAI sta lavorando su a strumento simile. La stessa Anthropic ha affermato che questo non è qualcosa su cui ritengono che sarà in vantaggio per troppo tempo. Pensano che i laboratori di qualsiasi parte del mondo possano rilasciare questa tecnologia nei prossimi tre mesi, sei mesi, 12 mesi.

Sembra che, nei prossimi 12 mesi, questo sarà disponibile. Ed ecco perché hanno voluto rilasciare Mythos ora, in modo che le aziende e le banche possano anticipare tutti gli attacchi hacker che potrebbero verificarsi, quando tipi simili di tecnologia verranno rilasciati al grande pubblico, forse tra mesi.

Se questo è così pericoloso e ci sono così tanti rischi potenziali, c’è qualcuno che sta discutendo sul fatto di non rilasciare strumenti come questo e semplicemente di chiuderli, mantenendoli interni?

Questa è davvero un’ottima domanda. Sono così felice che tu l’abbia chiesto, perché non abbastanza persone si chiedono se un sistema di intelligenza artificiale debba effettivamente essere rilasciato o utilizzato per determinate cose. In questo momento, stiamo assistendo a molti tipi di integrazione validi per tutti e adatti a tutto. E molte volte l’intelligenza artificiale non è la risposta alle cose.

Con questo, però, le persone tendono a concordare sul fatto che è qualcosa di necessario in questo momento. L’intelligenza artificiale è già disponibile per aiutare gli aggressori informatici a intensificare davvero i loro attacchi. E lo abbiamo visto intensificarsi nell’ultimo anno. Le persone sembrano concordare sul fatto che, in sostanza, è necessaria l’intelligenza artificiale per combattere gli attacchi informatici dell’intelligenza artificiale.

È un po’ come nelle fortezze medievali, dove aggiungi pietre extra e costruisci le mura della fortezza più in alto perché sta arrivando una guerra. Questa è la sensazione che ho quando ne parlo con questi esperti. Sanno che sta arrivando. È solo: “Cerca di rafforzare le tue difese adesso in modo da essere preparato al meglio”.