Venerdì il presidente Donald Trump ha ordinato all’intero governo federale di smettere di utilizzare i prodotti della società di intelligenza artificiale Anthropic per fermare quella che ha definito una “sinistra radicale, società sveglia” dall’invadere il processo decisionale dei militari.

La faida pubblica tra il Pentagono e l’Anthropic, che ha portato all’inserimento dell’azienda nella lista nera, è diventata di fatto un proxy per la più ampia battaglia sull’industria futura governance dell’intelligenza artificiale.

La copertura si è concentrata sul rifiuto di Anthropic di abbandonare le sue due “linee rosse” – utilizzare il suo prodotto nella sorveglianza domestica di massa o per alimentare armi completamente autonome – e sulla possibilità che il Pentagono del Segretario alla Difesa Pete Hegseth utilizzi un software potente con un requisito più flessibile di usarlo solo in modo “legale”, come richiede l’amministrazione.

Ma, secondo quanto riportato questa settimana, lo scontro che ha scatenato la faida si è in realtà concentrato su una questione diversa ma correlata: come l’intelligenza artificiale potrebbe essere utilizzata in caso di attacco nucleare contro gli Stati Uniti.

Semafor e il Washington Post hanno riferito che all’inizio di dicembre, il sottosegretario alla Difesa per la ricerca e l’ingegneria Emil Michael ha chiesto a Dario Amodei di Anthropic se, in uno scenario in cui i missili nucleari volassero verso gli Stati Uniti, la società “si rifiuterebbe di aiutare il suo paese a causa del divieto di Anthropic di usare la sua tecnologia insieme ad armi autonome”. Fonti dell’amministrazione dicono che Michael si è infuriato quando Amodei ha detto che il Pentagono avrebbe dovuto contattare Anthropic e verificare. Anthropic nega la storia e afferma di essere disposta a creare un’eccezione per la difesa missilistica, ma in ogni caso la conversazione ha avvelenato i rapporti tra le due istituzioni. (Divulgazione: Vox’s Future Perfect è finanziato in parte dalla Fondazione BEMC, il cui principale finanziatore è stato anche uno dei primi investitori in Anthropic; non hanno alcun input editoriale sui nostri contenuti.)

Come io riportato per Vox a novembreè in corso un dibattito attivo su se e come l’intelligenza artificiale debba essere integrata nei sistemi di comando e controllo nucleare. Non sappiamo fino a che punto lo sia già, ma sappiamo che l’esercito americano sta attivamente cercando modi in cui l’intelligenza artificiale e l’apprendimento automatico possono essere utilizzati “per consentire e accelerare il processo decisionale umano”.

Le discussioni sulle armi nucleari e sull’intelligenza artificiale tendono a concentrarsi sulla possibilità che alle macchine venga mai dato il controllo della capacità di farlo lancio armi nucleari e l’imperativo di mantenere un “umano coinvolto” nelle discussioni sull’uso delle armi mortali dell’umanità. Ma molti esperti e funzionari sostengono che il dibattito è il frutto a portata di mano: né gli Stati Uniti, né nessun altro paese, probabilmente, affideranno mai all’IA la decisione sull’ordine o meno di un attacco nucleare.

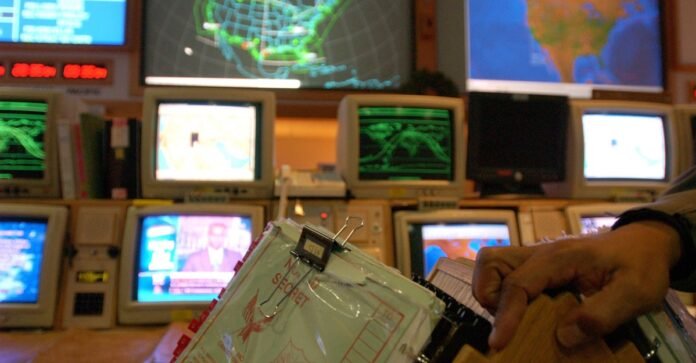

Una questione molto più complicata è fino a che punto si dovrebbe fare affidamento sull’intelligenza artificiale per funzioni come l’“avviso strategico”, ovvero la sintesi dell’enorme quantità di dati raccolti da satelliti, radar e altri sistemi di sensori per rilevare potenziali minacce il prima possibile.

Questo è il tipo di caso d’uso ipotetico che sembra che Michael stesse proponendo ad Amodei. Se il sistema viene utilizzato solo per darci maggiori possibilità di farlo abbattendo un missile in arrivo, potrebbe sembrare un gioco da ragazzi.

Ma in uno scenario in cui gli Stati Uniti fossero sotto attacco con missili balistici, il presidente si troverebbe immediatamente di fronte a una decisione – che dovrebbe essere presa in pochi minuti – sull’opportunità di reagire, scatenando potenzialmente una guerra nucleare in piena regola.

La vita di milioni di persone potrebbe dipendere dal fatto che il sistema funzioni nel modo giusto – e ci sono moltissimi esempi tratti dalla storia delle armi nucleari dei sistemi di rilevamento che portano a quasi incidenti che sono stati evitati solo dall’intuizione umana.

La tecnologia per eseguire questo tipo di rilevamento delle minacce probabilmente non esiste ancora, il che, data la posta in gioco, potrebbe essere stato uno dei motivi per cui Amodei era riluttante a impegnarsi in questo scenario.

Il tenente generale in pensione Jack Shanahan, che ha volato in missioni nucleari nell’aeronautica militare e in seguito è stato capo del Centro congiunto di intelligenza artificiale del Pentagono, ha detto a Vox che se il rilevamento e la risposta alla minaccia nucleare fossero affidati agli agenti di intelligenza artificiale, “Non voglio dire che è certo che ci sarà una catastrofe, ma penso che tu stia andando su quella strada.”

Ha indicato a studio ampiamente riportato pubblicato questa settimana da un ricercatore del King’s College di Londra che ha scoperto che i modelli di intelligenza artificiale tra cui Claude, ChatGPT e Google Gemini erano molto più propensi dei partecipanti umani a raccomandare opzioni nucleari nei giochi di guerra simulati. In questo scenario, un’intelligenza artificiale potrebbe non lanciare un’arma, ma un presidente dovrebbe annullare la prescrizione di un sistema multimiliardario in preda al panico sotto estrema pressione.

Un fattore che rende l’uso militare dell’intelligenza artificiale diverso dalle tecnologie precedenti con ovvi usi di sicurezza nazionale è che, in questo caso, gran parte della ricerca all’avanguardia è stata condotta da aziende private che inizialmente avevano un occhio sul mercato commerciale, piuttosto che da aziende che rispondevano alla domanda militare. (Un esempio di quest’ultimo caso sarebbe Internet, che si è evoluto da Dipartimento della Difesa e progetti accademici molto prima che le aziende ne trovassero usi commerciali.)

La nuova dinamica è destinata a portare a scontri culturali, in particolare tra un’azienda come Anthropic che, sebbene fino ad ora sia stata felice di lasciare che il suo prodotto fosse utilizzato dal Pentagono, ha costruito la sua immagine pubblica attorno alle sue preoccupazioni sulla sicurezza dell’intelligenza artificiale, e il Pentagono “anti-woke” di Pete Hegseth.

“Boeing non si opporrebbe mai alla costruzione di qualsiasi cosa il governo gli chieda di costruire”, ha detto Shanahan, che ha guidato la controversa partnership del Pentagono del 2018 con Google, Project Maven, un precedente scontro culturale DC-Silicon Valley. “È un’azienda di base industriale-difesa. L’intelligenza artificiale è nata in un mondo molto diverso con un gruppo di persone che non vedono le cose nel modo in cui i dipendenti della Lockheed potrebbero aver visto la Guerra Fredda. In una certa misura è Marte-Venere.”

Il modo in cui si svolgerà lo scontro e se altre aziende saranno disposte a lasciare che i loro modelli vengano implementati con meno domande poste, potrebbe contribuire notevolmente a determinare quale ruolo l’intelligenza artificiale potrebbe svolgere in un’ipotetica guerra nucleare.

Questa storia è stata prodotta in collaborazione con Fondazione Outrider E Partner di finanziamento del giornalismo.